编者按

智能汽车产业滚滚向前,在这摧枯拉朽的关键变革期,不断涌现技术的交锋。《TechLab》科技实验室,将聚焦智能汽车产业重磅的科技创新,我们会深层次解析背后创新的原理,试图拨开云雾,看到智能汽车下一个十年。

作者|秦章勇

如果总结2025年最火热的词,莫过于AI,一年的时间,各行各业仿佛都经过了AI的洗礼,具身智能就是AI涌现的集大成,生产制造则用AI提质增速,打工人经常用AI软件做PPT、写资料以及做海报,善男信女们也用AI算命。

我们习惯了用AI给出答案和结果,并坚信比我们人类计算的更精准,事实真是这样吗?

当企业进入AI应用深水区,更具象的问题就会逐渐凸显出来,比如AI并不像想象中的那么容易落地,再有就是AI的输出结果差强人意,难以完全获得我们信任,对于自动驾驶行业来说,AI的一个差错,就可能酿成大祸。

归根到底,在于AI大模型先天具有“黑盒”特性,输出的结果很难保证完全正确。

最近科技博主小Lin和北京通用人工智能研究院院长朱松纯有一场对谈,就涉及到这个核心问题——为什么AI难落地?

这个问题延展到到自动驾驶,怎么让决策的逻辑“安全、可解释”,也成为车企的头等大事,车企和智驾企业逐渐演化出了VLM、世界模型等多条技术路线。

作为百年豪华车企,奔驰在处理这种问题就显得轻车熟路,因为有安全这条绝对底线,奔驰尝试把AI的黑箱变成“白盒”,自动驾驶的逻辑则是更安全、更负责、更守规矩。

01 AI大模型的边界

和规则算法相比,AI系统可以通过数据训练自动学习并适应新情况,无需显式编程,这让其更灵活且泛化能力更强,也是为什么AI大模型被称为第四次工业革命的核心。

但成败皆因此,不同于规则的强因果指导,很长一段时间,我们都不能理解AI是怎么做出决策和输出的。

在这里我们先简单熟悉一下,AI运转的基本原理。

作为一种大模型,AI做出决策时并不会像我们人类一样,对一个图片、一句话或者一段文字整个做出理解,而且先将输入的这些数据转换为更小的单元,也就是Token(词元),这些Token是模型处理和生成内容的基本单元。

随后AI会在自己模型的内部结构中,根据输入的Token来预测下一个Token,再把预测出来的Token转化成输出的结果。

开发人员可以决定算法和数据,投喂给AI大模型之后得到结果,至于中间的过程——AI是怎么推导结果的,就成为诡秘的“黑盒”。由于大模型的这种向量表达,让其具有天然的不可解释性。

所以关于AI有个形象的比喻——训练大模型,就是科技界的现代炼丹术。

决策过程不透明,就会影响信任度,尤其是深度学习模型,依赖庞大的参数“炼丹”,但最终得出的结果往往差强人意,这种问题在法律或金融等高风险领域应用时,更容易凸显出来。如果数据过于复杂且随机,还容易出现大模型幻觉。

具体到自动驾驶,就是安全性堪忧,车辆在自动驾驶状态下,有可能出现识别误判,系统如果错误地把广告牌识别为停止标志并紧急刹车时,就很难追溯是哪个特征触发了错误判断。

除了黑盒的不可解释性,AI大模型需要大量数据进行训练,这也涉及到了大模型的能力边界问题——严重依赖数据质量。

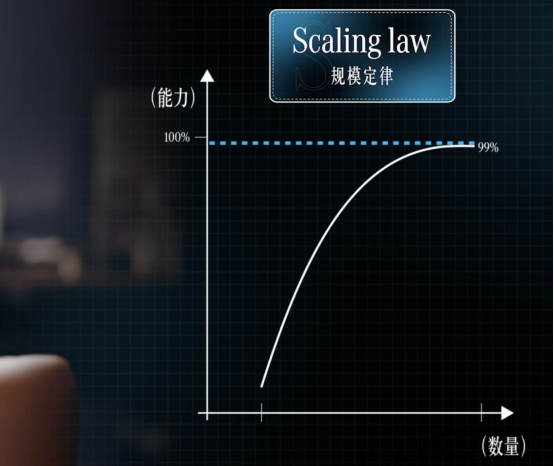

这就比较容易理解了,大模型需要大量的数据训练,这些数据的完整性和准确性,直接决定了大模型的可靠性。而大模型预训练的核心原则是Scaling Law(规模化法则),也就是说,只要使用更多数据训练更大模型,就能得到更好的结果。过去很长一段时间,都是Scaling Law指引着AI研究的方向。

但由于Scaling Law的数学关系遵循幂律分布,意味着模型的性能会随规模扩大,在解决问题时呈现边际效益递减特征。

很多大模型预训练初期会遵循大力出奇迹,数据量呈几何式增长,但到了后期,新增数据对提升性能的边际效益降低,导致损失函数下降速度减缓,这就出现了学习饱和现象。

但在实际应用时,就需要面对各种各样复杂的场景,我们永远无法把所有黑天鹅事件都放到大模型去训练。

这也是自动驾驶行业常说的长尾场景,在交通中发生频率比较低但种类非常多的情况,比如极端天气、异形物体识别以及人类行为不可预测性等,都很难通过现实数据充分训练。

面对大模型这些天生的缺陷,车企又该如何用好它?

02 以安全为底线的白盒逻辑

2023年12月,奔驰拿到北京L3级高速公路测试资格,2024年8月,又获得L4级的测试资格,这让奔驰成为第一家获得北京指定城市道路和L4级自动驾驶测试批准的国际汽车制造商。更早的2021年,奔驰就已经在德国拿到政府批准的L3级商用自动驾驶系统。

在事故责任难以厘清的背景下,奔驰之所以能狂飙突进,一个很大的原因在于,奔驰可以在AI黑盒不可解释性中,增加了法律层面的“可解释性”。

面对自动驾驶,奔驰一贯的策略是“以人为本”,也就是安全永远都是第一位,基于此,奔驰对自动驾驶进行了多重安全冗余以及制约。

首先就是我们都能看到的物理冗余,奔驰在制动系统、转向系统甚至车载电网等方面采用了冗余备份架构。比如奔驰的转向控制,就用了双回路架构,配合制动与供电系统的冗余备份,即使某一模块故障,冗余系统仍能确保车辆可控,这也让奔驰的“失效概率”可以压缩至业内最低。

再有就是奔驰强大的安全系统,在奔驰的软件架构中叫做安全力场SFF。

安全力场的全称是自动驾驶安全防护场(Safety Force Field ),最早由英伟达提出,该框架是用数学验证的计算模型保障自动驾驶安全,工作的逻辑是通过实时摄入传感器数据,分析并预测环境动态,输出相应动作,从而避免车辆碰撞,不引发危险场景。

如果说物理冗余是给车辆加了一层保险,那么安全力场SFF,则是用来约束、规范AI大模型的防护网。

我们都知道,AI容易出现幻觉或者面对长尾场景比较被动,比如车辆在面对一个不规则物体时,AI可能会认为是一个塑料袋,车辆可以直接加速穿过去。

这个时候,奔驰的安全力场就会介入,通过激光雷达传来的物理数据来进行计算,判断出前方有障碍物阻挡驾驶,意识到会对安全产生威胁,如果不刹车将会产生碰撞,所以车辆会终止AI大模型给出的加速指令,发挥AEB的功能,果断刹车。

我们可以看到,以安全为前提的背景下,奔驰会利用系统2的物理规则,去约束系统1的直觉大模型,提前抹除交通隐患。

除了有安全力场用来确定性兜底,奔驰在数据方面也可以解释合理性。

2024年1月,奔驰就申请了一项名为“用于存储车辆数据的方法和系统,车辆和计算机程序产品”的专利,这是一种用于存储车辆数据的方法,可以监测事件记录的触发条件,并基于与所述触发条件关联的信号判断触发条件是否满足等。

如今奔驰已有一套完整的自动驾驶数据存储系统(DSSAD),不仅可以记录车辆的行驶轨迹,还可以记录决策的逻辑,可以判断是否是传感器遮挡, 亦或者定位丢失等等。凭借这套记录的数据,就可以重构决策的过程,也具备了法律层面的“可解释性”。

03 建立信任的三部曲

奔驰为AI做多道防线的背后,是AI和人类社会脆弱的信任关系,这也是AI Agent落地难的症结。

人与人之间建立信任,是一种直觉的反应,这种直觉可以通过行为判断来善意,通过回应确认存在,也可以通过关系来衡量责任。但对于AI智能体来说,这个逻辑不在适用,因为我们创造了比我们更难理解的物体。

这也有AI大模型本身局限性原因,Next Token Prediction(预测下一个词/动作)作为大模型的核心训练范式,每次预测都依赖于前序生成结果,这就导致早期小问题会在后续步骤中无限放大,而且大模型缺乏对全局语义或跨概念关系的理解能力。

这种局限性在需要多步规划或复杂推理的长尾任务中,就会彻底暴露出来。

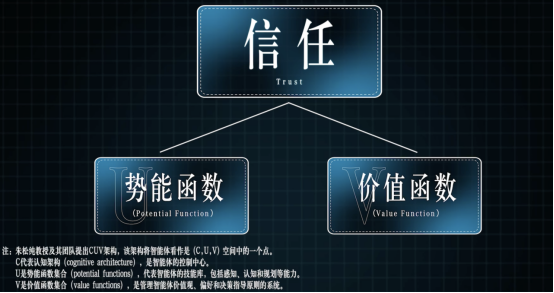

针对人和AI如何建立信任,朱松纯教授及其团队提出了CUV架构,其中C代表认知架构,是智能体的控制中心,U是势能函数集合,是智能体的技能库。V则是价值函数集合,是管理智能体的价值观、偏好和决策原则的系统。

在训练过程中,认知架构是衡量U和V的关键,按照认知架构,可以决定是否以效率(U)为先,还是以价值观(V)为先。

对应到汽车行业,目前很多自动驾驶会非常激进,比如抢黄灯、压道变线,或者加塞等等,这些会被我们认为是非常“老司机”。

不过对于奔驰来说,人和AI需要建立一个强信任的关系,也就是说奔驰会把“V”放大,一切行动都应该建立在安全的基础上,比如尊重规则,绝对不会去抢黄灯,即便在没有红绿灯的斑马线上,也会礼让行人。

给AI划定红线后,奔驰的AI和人类相处起来,也会更融洽。

解决了信任问题,AI Agent的下一步就是需要理解人,成为人类的朋友。

在很多情况下,AI Agent更像是一个冰冷的机器,甚至有观点认为,AI不需要理解世界,也不会真正理解任何东西。

按照朱松纯的观点,让AI Agent成为人类的朋友,需要给AI“立心”,除了上面所说的“V”之外,还需要让AI拥有独立心智,也就是“意图理解”的能力。

奔驰也朝着这个方向努力,2025年9月,奔驰和字节跳动宣布战略合作全面升级,新车搭载的豆包大模型,让奔驰虚拟助手反应更快,同时拥有了短期记忆和上下文理解的能力。

当系统的安全属性到足以抹除一切隐患,AI能够真正理解需求、满足需求,信任就会水到渠成,AI Agent落地也不再有阻碍。

这或许就是奔驰在“安全至上”的造车理念中,想要达到的本质目的。